La série Harry Potter a habitué le monde à l'idée de portraits vivants avec ses peintures parlantes et ses photographies en mouvement. Mais la semaine dernière, quand un «portrait vivant» généré par l'IA de Mona Lisa de Leonardo da Vinci a commencé à circuler sur le Web, de nombreuses personnes ont été étonnées lorsque le célèbre portrait a remué ses lèvres et a regardé autour de lui.

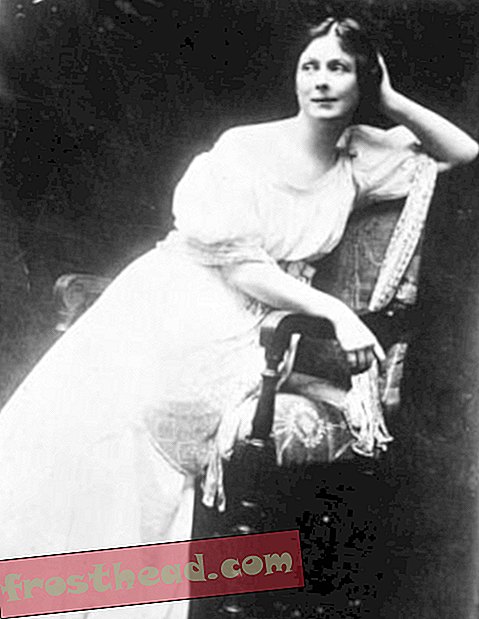

Le portrait animé de Lisa Gherardini faisait partie de plusieurs nouveaux «modèles de tête parlante», plus communément appelés «deepfakes», créés par des chercheurs du Centre de l'IA de Samsung à Moscou et de l'Institut des sciences et technologies de Skolkovo. À l'aide de quelques cadres de référence ou même d'une seule image, les chercheurs ont également procédé à la simulation de célébrités telles qu'Oprah, mis en lumière des instantanés uniques de Marilyn Monroe et Albert Einstein, et créé de nouvelles expressions pour des images célèbres telles que Fille à la perle de Vermeer.

Les chercheurs ont publié sur YouTube leur méthode, qu’ils appellent «peu d’apprentissage par apprentissage», et dans un article qui n’a pas encore été revu par des pairs sur le référentiel de pré-impression arXiv.org. Alors que les détails deviennent assez techniques, Mindy Weisberger de LiveScience rapporte que pour produire des portraits vivants, un type d'intelligence artificielle appelé réseau de neurones convolutifs s'entraîne en analysant des images de référence. Il applique ensuite les mouvements du visage d'une série de cadres à une image statique, comme la Mona Lisa . Plus il y a d'angles et d'images de référence, meilleur est le portrait vivant. Selon l'article, l'IA pourrait produire un «réalisme parfait» (mesuré par la capacité des humains à discerner laquelle des trois séries d'images étaient deepfakes) en utilisant seulement 32 images de référence.

La Mona Lisa, bien sûr, n’est qu’une image. Les trois «portraits vivants» du chef-d’œuvre de Leonardo sont un peu troublants. Pour les animations brèves, le réseau de neurones a observé trois vidéos d’entraînement différentes, et les trois versions de Mona Lisa basées sur ces images semblent chacune avoir une personnalité différente. Si Leonardo avait peint son célèbre modèle sous différents angles, le système aurait pu produire un portrait vivant encore plus réaliste.

Alors que la Mona Lisa animée est divertissante, la montée en puissance de deepfakes a fait craindre que les similarités générées par ordinateur ne soient utilisées pour diffamer des personnes, attiser les tensions raciales ou politiques et éroder davantage la confiance dans les médias en ligne. «Ils minent notre confiance dans toutes les vidéos, y compris celles qui sont authentiques», écrit John Villasenor, de la Brookings Institution. "La vérité elle-même devient insaisissable, car nous ne pouvons plus être sûrs de ce qui est réel et de ce qui ne l'est pas."

Bien que l'IA soit utilisée pour créer des deepfakes, Villasenor indique que, du moins pour le moment, elle peut également être utilisée pour identifier des deepfakes en recherchant des incohérences qui n'apparaissent pas à l'œil humain.

Tim Hwang, directeur de l'initiative sur l'éthique et la gouvernance de Harvard-MIT, a déclaré à Gregory Barber de Wired que nous ne sommes pas encore au point où les mauvais acteurs peuvent créer des deepfakes sophistiqués sur leurs ordinateurs portables personnels. «Rien ne me dit que vous utiliserez ceci clé en main pour générer des deepfakes chez vous», dit-il. "Pas à court terme, moyen terme, ni même à long terme."

En effet, le nouveau système de Samsung est coûteux et nécessite une expertise. Mais l'article de Barber souligne qu'il ne faut pas une vidéo super-sophistiquée photo-réaliste réalisée par un réseau de neurones pour tromper les gens. Pas plus tard que la semaine dernière, une vidéo manipulée qui avait été ralentie pour faire en sorte que le président de la Chambre des représentants des États-Unis, Nancy Pelosi, se saoule en état d'ébriété circule sur les réseaux sociaux.

Finalement, la technologie sera suffisamment efficace pour que les mauvais acteurs soient capables de produire des deepfakes si convaincants qu’ils ne peuvent pas être détectés. Quand ce jour viendra, dit Hwang à Wired, les gens devront s’appuyer sur des indices contextuels et de vérification des faits pour déterminer ce qui est réel et ce qui est faux. Par exemple, si le demi-sourire aux lèvres de Mona Lisa se transforme en un sourire plein de dents et qu’elle essaie de vous vendre un dentifrice blanchissant, c’est sûrement un faux-semblant.