![]()

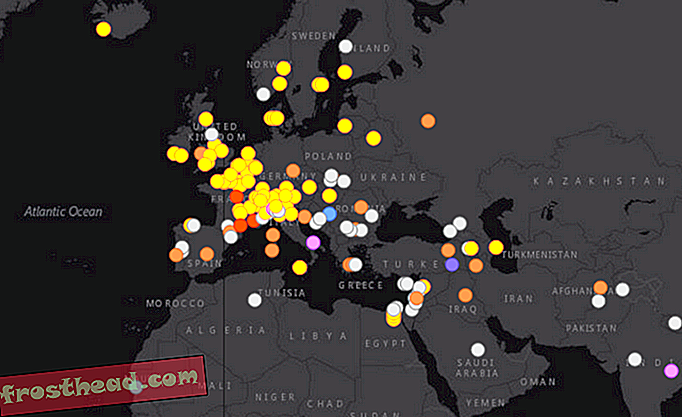

Analyse faciale au travail. Image reproduite avec l'aimable autorisation d'Affectiva

Bien que nous passions beaucoup de temps avec nos téléphones cellulaires, nos ordinateurs portables et nos tablettes, la relation n’est plus à sens unique. Nous agissons, ils répondent. Bien sûr, vous pouvez entretenir une conversation avec Siri sur votre iPhone et, même si elle est rapide, elle ne peut guère être qualifiée de plaisanterie ludique. Vous posez des questions, elle donne des réponses.

Mais si ces appareils pouvaient vraiment lire nos émotions? Et s'ils pouvaient interpréter chaque petit geste, chaque signal du visage afin de pouvoir mesurer nos sentiments aussi bien que - peut-être mieux que - nos meilleurs amis? Et ensuite, ils répondent, non pas avec des informations, mais avec ce qui pourrait passer pour de l'empathie.

Nous n'en sommes pas encore là, mais nous allons rapidement dans cette direction, guidés par un domaine scientifique connu sous le nom d'informatique affective. Il repose sur un logiciel capable de mesurer, d'interpréter et de réagir aux sentiments humains. Cela peut impliquer de capturer votre visage sur l'appareil photo, puis d'appliquer des algorithmes à chaque aspect de vos expressions pour tenter de donner un sens à chaque frimousse. Vous pouvez également lire votre niveau d'ennui ou de plaisir en indiquant à quelle vitesse ou avec quelle force vous tapez sur un texte ou si vous utilisez des émoticônes. Et si vous semblez trop agité (ou saoulé), vous pourriez recevoir un message vous suggérant de ne pas appuyer sur l'icône d'envoi.

Voyant combien il est difficile pour nous, humains, de donner un sens à d’autres humains, cette notion de programmation de machines pour lire nos sentiments n’est pas un mince défi. Mais cela prend de la vitesse, alors que les scientifiques concentrent leurs efforts sur l'enseignement de l'intelligence émotionnelle aux appareils.

Chaque mouvement que vous faites

L'un des meilleurs exemples de la façon dont l'informatique affective peut fonctionner est l'approche d'une entreprise appelée Affectiva, à juste titre. Il enregistre les expressions puis, à l'aide d'algorithmes exclusifs, analyse les signaux faciaux, puisant dans une base de données de près de 300 millions de cadres d'éléments de visages humains. Le logiciel a été perfectionné au point qu’il peut associer diverses combinaisons de ces éléments à différentes émotions.

Lorsqu'il a été mis au point au Media Lab du MIT par deux scientifiques, Rosalind Picard et Rana el Kaliouby, le logiciel, connu sous le nom d'Affdex, a été conçu dans le but d'aider les enfants autistes à mieux communiquer. Mais il avait clairement beaucoup de potentiel dans le monde des affaires et le MIT a donc transformé le projet en une entreprise privée. Il a depuis recueilli 21 millions de dollars auprès d'investisseurs.

Alors, comment utilise-t-on Affdex? Le plus souvent, c'est regarder des gens regarder des publicités. il enregistre les personnes lorsqu'elles regardent des annonces sur leurs ordinateurs - ne vous inquiétez pas, vous devez choisir cette option - puis, sur la base de sa base de données de repères faciaux, évalue ce que les téléspectateurs pensent de ce qu'ils ont vu. Et le logiciel ne fournit pas simplement un verdict positif ou négatif; il décompose les réactions des téléspectateurs seconde par seconde, ce qui permet aux annonceurs d'identifier, avec plus de précision que jamais, ce qui fonctionne et ce qui ne fonctionne pas dans une publicité.

Il est également capable de voir que si les gens disent une chose, leur visage peut en dire une autre. Lors d'une interview avec le Huffington Post, El Kaliouby a donné l'exemple de la réponse à une publicité pour une lotion pour le corps diffusée en Inde. Pendant la publicité, un mari touche de manière ludique le ventre exposé de sa femme. Par la suite, un certain nombre de femmes qui l'avaient regardée ont déclaré avoir trouvé la scène choquante. Mais, selon el Kaliouby, les vidéos des téléspectateurs montraient que chacune des femmes réagissait à la scène avec ce qu’elle appelait un «sourire de joie».

Elle voit des opportunités au-delà du monde de la publicité. Les téléviseurs intelligents pourraient être beaucoup plus intelligents sur le type de programmes que nous aimons s'ils sont capables de développer une banque de mémoire d'expressions faciales. Et les politiciens seraient en mesure d’obtenir des réactions en temps réel à chaque phrase qu’ils énoncent lors d’un débat et d’adapter leurs messages à la volée. De plus, dit El Kaliouby, il pourrait y avoir des applications pour la santé. Elle dit qu'il est possible de lire le rythme cardiaque d'une personne avec une webcam en analysant le flux sanguin dans son visage.

«Imaginez avoir une caméra tout le temps surveillant votre fréquence cardiaque», a-t-elle déclaré au Huffington Post, «afin qu'elle puisse vous dire si quelque chose ne va pas, si vous avez besoin d'être plus en forme, ou si vous vous plissez les sourcils. temps et besoin de se détendre. "

Alors, qu'en pensez-vous, effrayant ou cool?

Dispositifs de suivi

Voici cinq autres façons dont les machines réagissent aux émotions humaines:

- Et comment était ma journée?: Des chercheurs de l'Université de Cambridge ont développé une application mobile Android qui surveille le comportement d'une personne tout au long de la journée, en utilisant des appels et des SMS entrants, ainsi que des publications sur les réseaux sociaux pour suivre son humeur. L'application, appelée «Emotion Sense», est conçue pour créer un «voyage de découverte», permettant aux utilisateurs de disposer d'un enregistrement numérique des pics et des vallées de leur vie quotidienne. Les données peuvent être stockées et utilisées pour des séances de thérapie.

- Et voici moi après la troisième tasse de café: Ensuite, il y a Xpression, une autre application de suivi de l'humeur créée par une société britannique appelée EI Technologies. Au lieu de compter sur les personnes en thérapie pour tenir le journal de leurs changements d'humeur, l'application écoute les modifications dans la voix d'une personne afin de déterminer si elle se trouve dans l'un des cinq états émotionnels: calme, heureuse, triste, en colère ou anxieuse / effrayée. Il conserve ensuite une liste des humeurs d'une personne et du moment où elles changent. Et, si la personne le souhaite, cet enregistrement peut automatiquement être envoyé à un thérapeute à la fin de chaque journée.

- Et si vous détestiez juste taper sur un téléphone? Les scientifiques de Samsung travaillent sur un logiciel qui permettra d'évaluer votre état d'esprit en fonction de la manière dont vous tapez vos tweets sur votre smartphone. En analysant à quelle vitesse vous tapez, combien le téléphone tremble, combien de fois vous reculez et combien d'émoticônes que vous utilisez, le téléphone devrait pouvoir déterminer si vous êtes en colère, surpris, heureux, triste, craintif ou dégoûté. Et en fonction de la conclusion qu'il tire, il pourrait inclure dans votre tweet l'émoticône approprié pour informer vos suiveurs de votre état d'esprit.

- Évitez simplement d’inviter vos amis à regarder: à l’ aide d’un capteur porté au poignet et d’une caméra smartphone placée autour du cou, les chercheurs du MIT ont créé un système de «suivi à vie» qui collecte des images et des données conçues pour montrer à une personne les événements représentés. leurs hauts et leurs bas émotionnels. Le système, appelé Inside-Out, comprend un biocapteur intégré dans un bracelet qui permet de suivre les émotions exacerbées par des charges électriques dans la peau, tandis que le smartphone surveille la position de la personne et prend plusieurs photos à la minute. À la fin de la journée, l'utilisateur peut visualiser ses expériences, ainsi que toutes les données du capteur.

- Votre front dit que vous avez des problèmes: C'était probablement inévitable. Des chercheurs de l'Université de Californie du Sud ont créé un thérapeute robotique non seulement programmé pour encourager les patients atteints de «Uh-huhs» bien synchronisés, mais également expert en capteurs de mouvement et en analyse vocale à interpréter chaque geste et chaque voix d'un patient. inflexion pendant une séance de thérapie.

Bonus vidéo: Vous voulez voir à quel point cette tendance d'appareils de lecture des émotions humaines peut devenir bizarre? Découvrez cette promotion de Tailly, une queue mécanique qui capte votre niveau d’excitation en suivant votre fréquence cardiaque, puis remue de manière appropriée.

Plus de Smithsonian.com

Ce nouveau robot a le sens du toucher

Cuisiner avec des robots